Kuriama: išmanieji telefonai, galintys įvertinti nuotaiką

Programoje neanalizuojama, ką žmogus kalba, o kaip - kaip.

„Mes iš tikrųjų naudojome aktorių įrašus, skaitančius mėnesio datą - iš tikrųjų nesvarbu, ką jie sako, o tai, kaip jie sako, domina mus“, - sakė Wendi Heinzelman, profesorė. elektros ir kompiuterių inžinerijos.

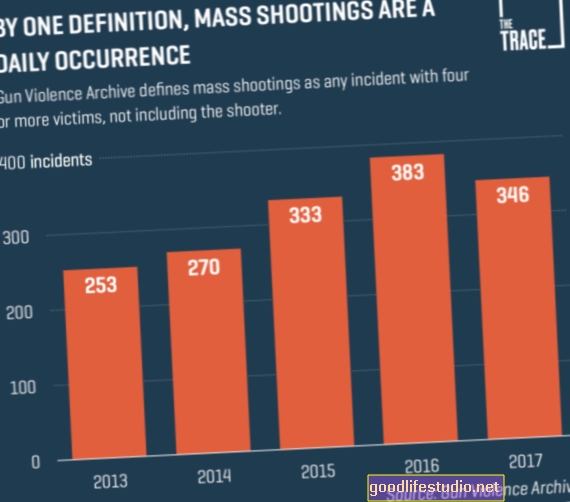

Programa analizuoja 12 kalbos ypatybių, tokių kaip aukštis ir garsumas, kad nustatytų vieną iš šešių garso įrašo emocijų. Mokslininkai teigia, kad jis pasiekia 81 proc. Tikslumą, o tai yra reikšmingas patobulinimas, palyginti su ankstesniais tyrimais, kurie pasiekė tik apie 55 proc. Tikslumą.

Tyrimas jau buvo naudojamas kuriant programos prototipą, rodantį laimingą arba liūdną veidą po to, kai jis įrašo ir analizuoja vartotojo balsą. Ją pastatė vienas iš Heinzelmano magistrantų Na Yangas vasaros stažuotės metu „Microsoft Research“.

„Tyrimai dar tik ankstyvaisiais laikais, - pripažino Heinzelmanas, - tačiau lengva įsivaizduoti sudėtingesnę programą, kuri galėtų naudoti šią technologiją viskam, pradedant koreguoti mobiliajame telefone (telefone) rodomas spalvas ir grojant muziką, atitinkančią jūsų poreikius. įrašęs balsą jaučiuosi “.

Heinzelman ir jos komanda bendradarbiauja su Ročesterio psichologais dr. Melissa Sturge-Apple ir Patrickas Daviesas, kurie šiuo metu tiria paauglių ir jų tėvų sąveiką. „Patikimas emocijų kategorizavimo būdas gali būti labai naudingas atliekant tyrimus“, - sakė Sturge'as-Apple. "Tai reikštų, kad tyrėjui nereikia klausytis pokalbių ir rankiniu būdu įvesti skirtingų žmonių emocijų skirtingais etapais."

Tyrėjų teigimu, kompiuterio mokymas suprasti emocijas prasideda nuo to, kaip atpažįsta, kaip žmonės tai daro.

"Galite išgirsti ką nors kalbant ir galvojant:" o, jis skamba piktai ". Bet kas priverčia jus taip galvoti?" - sakė Sturge-Apple.

Ji paaiškino, kad emocijos veikia žmonių kalbėjimą keisdamos savo kalbos garsumą, aukštį ir net harmoniką. "Mes nekreipiame dėmesio į šias funkcijas atskirai, mes tiesiog sužinojome, kaip skamba piktas garsas, ypač pažįstamiems žmonėms", - pridūrė ji.

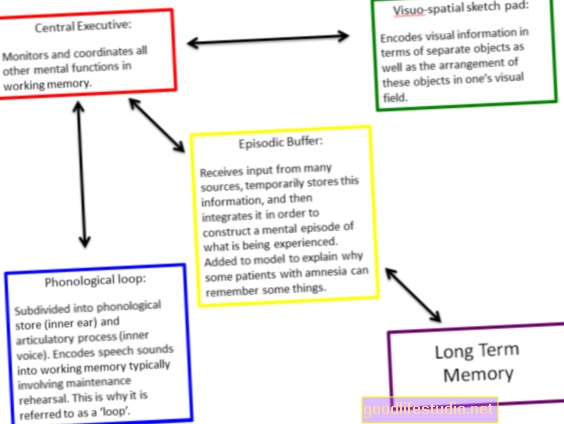

Tačiau norint, kad kompiuteris klasifikuotų emocijas, jis turi dirbti su išmatuojamais dydžiais. Taigi tyrėjai nustatė 12 specifinių kalbos bruožų, kurie buvo matuojami kiekviename įraše trumpais laiko tarpais. Tada tyrėjai suskirstė kiekvieną įrašą į kategorijas ir panaudojo juos mokydami kompiuterio programą, kaip skamba „liūdnai“, „laimingai“, „baimingai“, „šlykščiai“ ar „neutraliai“.

Tada sistema išanalizavo naujus įrašus ir bandė nustatyti, ar įraše esantis balsas atvaizduoja kokias nors žinomas emocijas. Jei kompiuterinė programa negalėjo nuspręsti tarp dviejų ar daugiau emocijų, ji tiesiog paliko tą įrašą neklasifikuojamą.

"Mes norime būti tikri, kad kai kompiuteris mano, kad įrašyta kalba atspindi tam tikrą emociją, labai tikėtina, kad ji tikrai vaizduoja šią emociją", - sakė Heinzelmanas.

Ankstesni tyrimai parodė, kad emocijų klasifikavimo sistemos labai priklauso nuo garsiakalbių, vadinasi, jos veikia daug geriau, jei sistemą mokys tas pats balsas, kurį ji analizuos. „Tai nėra idealu situacijai, kai norite tiesiog atlikti eksperimentą su grupe žmonių, kalbančių ir bendraujančių, pavyzdžiui, su tėvais ir paaugliais, su kuriais dirbame“, - sakė Sturge-Apple.

Nauji rezultatai patvirtina šią išvadą. Jei kalbos pagrindu sukurta emocijų klasifikacija naudojama kitokiu balsu nei tas, kuris mokė sistemą, tikslumas nukrito nuo 81 iki maždaug 30 procentų. Tyrėjai dabar ieško būdų, kaip sumažinti šį efektą, mokant sistemą balsu toje pačioje amžiaus grupėje ir tos pačios lyties atstovais.

"Vis dar yra iššūkių, kuriuos reikia išspręsti, jei norime naudoti šią sistemą aplinkoje, panašioje į realią situaciją, tačiau žinome, kad mūsų sukurtas algoritmas yra efektyvesnis nei ankstesni bandymai", - sakė Heinzelmanas.

Šaltinis: Ročesterio universitetas